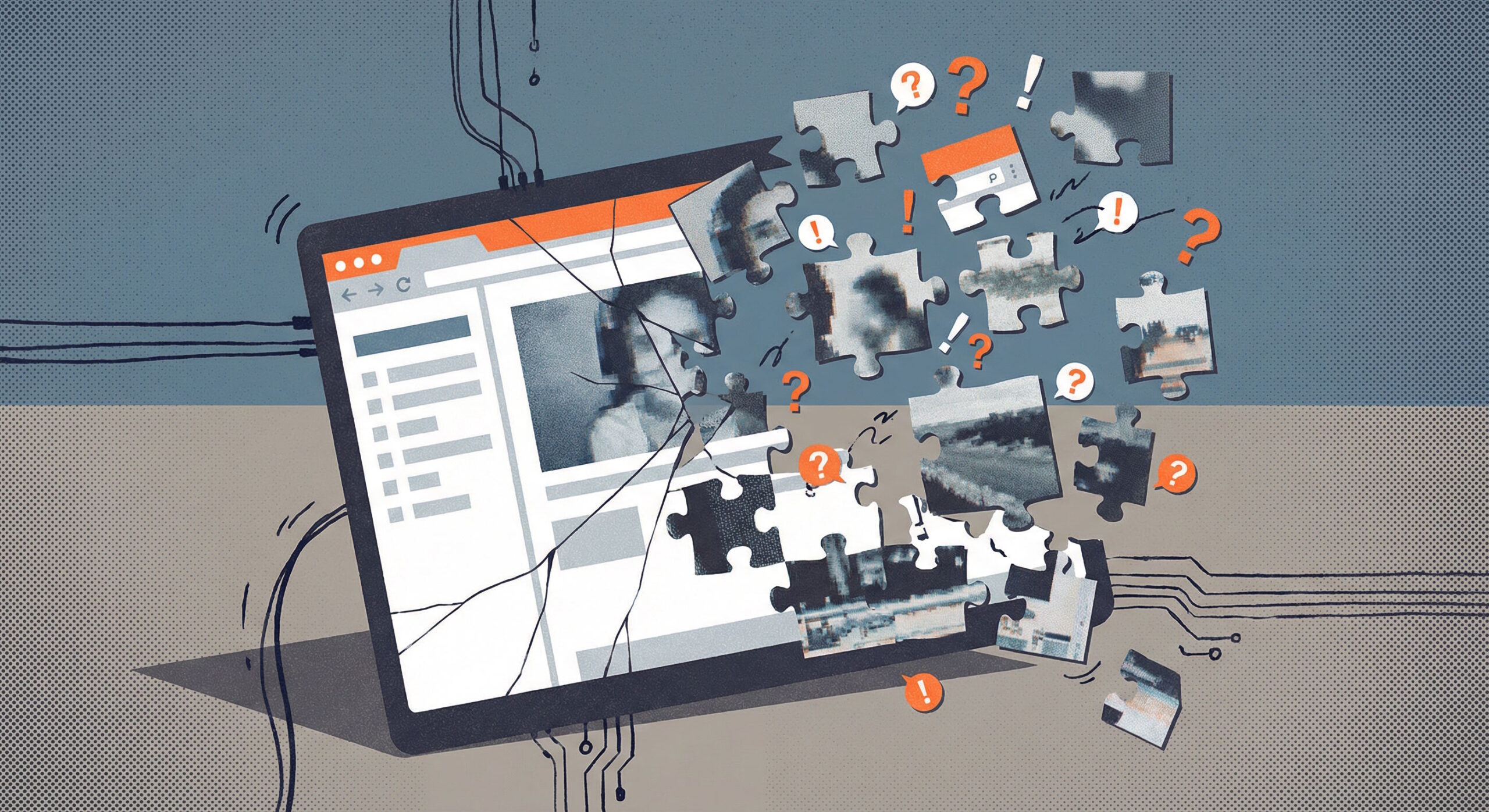

ProactiveBenchは、多峰性(マルチモーダル)言語モデルが、視覚情報が欠けているときにユーザーに助けを求めるかどうかを検証します。テストした22のモデルのうち、必要なものを尋ねるものはほとんどありませんが、単純な強化学習のアプローチが修正のヒントを示しています。

この記事 AIモデルは助けを求めるより推測してしまう――研究者が判明 は、The Decoder に最初に掲載されました。

THE DECODER / 2026/4/11

ProactiveBenchは、多峰性(マルチモーダル)言語モデルが、視覚情報が欠けているときにユーザーに助けを求めるかどうかを検証します。テストした22のモデルのうち、必要なものを尋ねるものはほとんどありませんが、単純な強化学習のアプローチが修正のヒントを示しています。

この記事 AIモデルは助けを求めるより推測してしまう――研究者が判明 は、The Decoder に最初に掲載されました。