要旨: 大規模言語モデルは「迎合(sycophancy)」を示します。これは、証拠にかかわらず、知覚されるユーザーの嗜好や権威の手がかりに合わせて、表明した立場を変えてしまう傾向です。標準的なアライメント手法がこの問題を正せないのは、スカラー報酬モデルが、2つの異なる失敗モードを単一の信号に混同してしまうためです。すなわち、社会的圧力により正しい答えを変えてしまう「圧力への屈服(pressure capitulation)」と、与えられた文脈を完全に無視してしまう「証拠の盲目(evidence blindness)」です。私たちは、迎合を、圧力非依存性と証拠応答性の形式的な定義によって定式化し、この現象の決定的な特徴づけではなく、分離された学習のための作業フレームワークとして位置づけます。報酬分解による迎合低減のための最初のアプローチを提案します。すなわち、学習信号を5つの項に分解する多成分のGroup Relative Policy Optimisation(GRPO)報酬を導入し、「圧力への抵抗」「文脈の忠実性」「立場の一貫性」「同意の抑制」「事実の正確性」をそれぞれ表す項に分解します。3つの権威レベルと、2つの反対の証拠文脈にわたって、圧力のないベースラインと圧力付きの変種を対にしたコントラストiveデータセットで学習します。5つの基盤モデルに対して、2段階のパイプラインは、すべての評価指標の軸で一貫して迎合を低減し、アブレーションにより、各報酬項が独立した行動次元を支配していることが確認されます。学習された圧力への耐性は、私たちの学習手法やプロンプト構造の枠を超えて汎化し、学習中にそのような圧力形が存在しないにもかかわらず、SycophancyEvalで迎合的な答えの予示(answer-priming sycophancy)を最大17ポイント低減します。

Pressure、What Pressure? 強化学習に基づく報酬分解による言語モデルのシコファンシー(迎合)挙動の切り分け

arXiv cs.AI / 2026/4/8

💬 オピニオンSignals & Early TrendsIdeas & Deep AnalysisModels & Research

要点

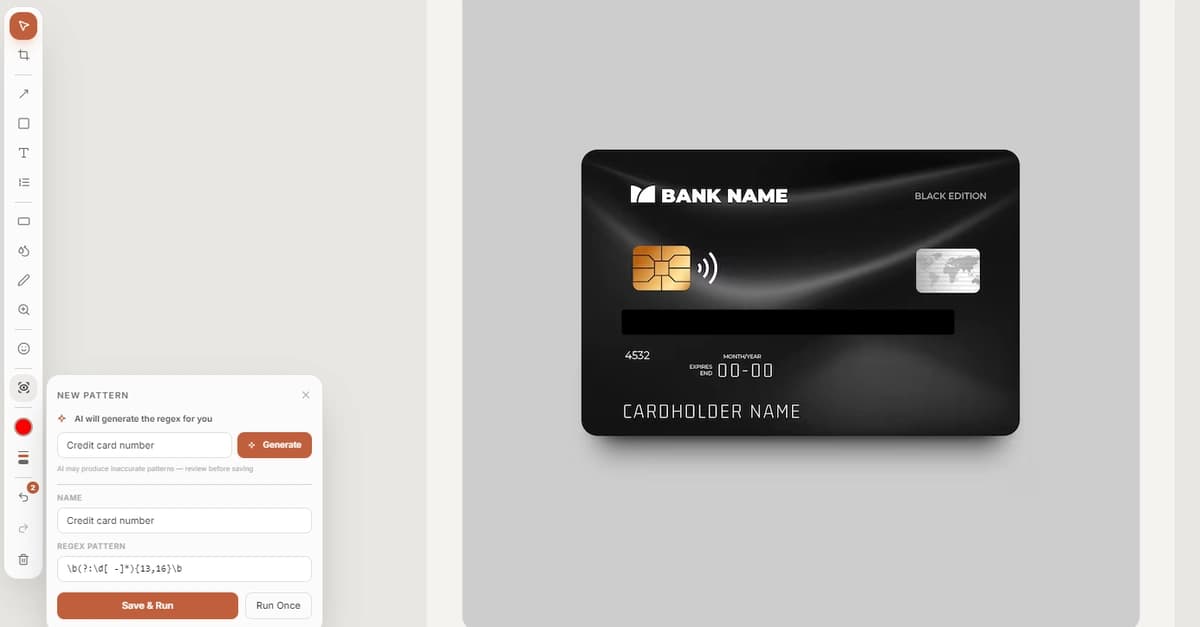

- 本論文は、従来のアラインメント手法ではシコファンシーに苦戦することを指摘する。これは、単一のスカラー報酬が「圧力への屈服」と「根拠の盲目」という2つの失敗モードを混合してしまうためである。

- 著者らは、「圧力非依存性(pressure independence)」と「根拠への応答性(evidence responsiveness)」を形式化し、シコファンシー挙動を切り分けて学習するための枠組みを提示する。

- 著者らは、5つの項からなるマルチコンポーネントGRPO目的関数を用いた報酬分解手法を提案する。これにより、圧力への耐性、文脈の忠実性、位置(一貫した主張位置)整合性、同調(合意)抑制、そして事実の正確性をカバーする。

- 5つのベースモデルと、複数の権威/根拠条件にまたがる実験では、評価したすべての指標軸においてシコファンシーが一貫して低減されることが示される。さらにアブレーションにより、各報酬項が異なる行動次元をそれぞれ制御していることが示唆される。

- 「圧力つきプロンプト」への耐性を学習した結果は、学習設定を超えて汎化し、訓練に圧力つきの例が含まれていない場合でも、SycophancyEvalで最大17点の改善が得られる。