生成AIは、組織が生産性、顧客体験、業務の実行能力に取り組む方法を大きく変えつつあります。業界を問わず、チームは生成AIを試し、新しい働き方を切り開こうとしています。これらの取り組みの多くは、技術的な実現可能性を示す説得力のあるPoC(Proof of Concept:概念実証)を生み出します。しかし、真の難題はそれらの初期の成功の後に始まります。PoCは頻繁に技術的な実現可能性を示すものの、組織はそれを、測定可能なビジネス価値をもたらす本番対応のシステムへと翻訳することに苦労しがちです。コンセプトから本番へ、そして本番から持続的な価値創造へ至る道のりは、技術面、組織面、ガバナンス面の各領域で課題を生み出します。

生成AIパス・トゥ・バリュー(P2V)フレームワークは、このギャップに対処するために作成されました。これは、生成AIの取り組みを、発想・検証(ideation and experimentation)から大規模な本番(production)へと体系的に移行することを支援するための、メンタルモデルと実践的なガイドを提供します。目標は、揺るぎない(durable)ビジネス価値を生み出すことです。

根本的な課題

生成AIの導入で最も中核となる課題は、イノベーションのスピードではありません。初期のパイロットはしばしば大きな期待を示し、チーム全体で熱意を生み出します。しかし、組織がそれらの解決策を業務として運用しようとすると進捗が鈍化します。データへのアクセスは、セキュリティやプライバシー要件によって制約されます。既存のエンタープライズシステムとの統合には、想定外の複雑さが伴います。ガバナンス、コンプライアンス、承認プロセスが摩擦(friction)を加えます。同時に、チームは、生成AIの能力とビジネス成果を結びつける一貫した成功指標を定義することにも苦労します。構造化されたアプローチがないと、これらの課題は相乗的に増幅します。多くの取り組みが、プロトタイプ、本番対応の準備(production readiness)、そして価値の実現の間で行き詰まります。組織が必要としているのは、これらの問題に対して意図的かつ包括的に対処できるフレームワークです。適切なフレームワークは摩擦を減らし、価値を生み出すまでの時間を加速します。

障壁(バリアー)の大きな4つのカテゴリ

組織が生成AIを、実験から本番運用、そして価値創造へと移行する際の課題は、常におおむね4つの主要カテゴリに分類されます。

- 価値(Value): 多くの生成AIの取り組みでは、明確に定義されたROI(投資対効果)や測定可能なビジネス成果が欠けています。具体的な成功基準がないと、継続投資を正当化したり、取り組みの優先順位を付けたりすることが難しくなります。

- リスク(Risk): 法的な露出(法的責任の可能性)、データプライバシー、セキュリティの脆弱性、そして風評への影響に関する懸念が、抵抗を生み出します。さらに、AIに関する規制の状況が変化し続けることで、コンプライアンス要件に関する不確実性が高まります。

- 技術(Technology): 生成AIを本番化する(productionizing)ことは、モデルの選定以外にも技術的な課題をもたらします。既存システムとの統合、インフラ要件、データ品質の問題、そして運用上の複雑性(観測可能性、スケーラビリティ、レジリエンス)は、しばしば過小評価されます。加えて、本番化の前段階における評価と検証は、依然として重要な課題です。デプロイ(展開)チームは、指標を確立し、テスト用データセットを構築し、複数のシナリオにわたって性能を測定し、品質を維持するための継続的なモニタリングを実装しなければなりません。コスト最適化やリソース管理に関するFinOpsの考慮事項も、これらの技術的な複雑性にさらに拍車をかけます。

- 人(People): 変化への抵抗、チーム内のスキルギャップ、生成AIが役割や責任に与える影響に関する不確実性、そして適切な専門性を見つけたり育成したりすることの難しさによって、導入は遅れます。

これらの障壁は、単独で現れることはほとんどありません。1つだけに対処しても、他の要因が残っている場合は、問題が解決されるというより別の形に移ることがよくあります。

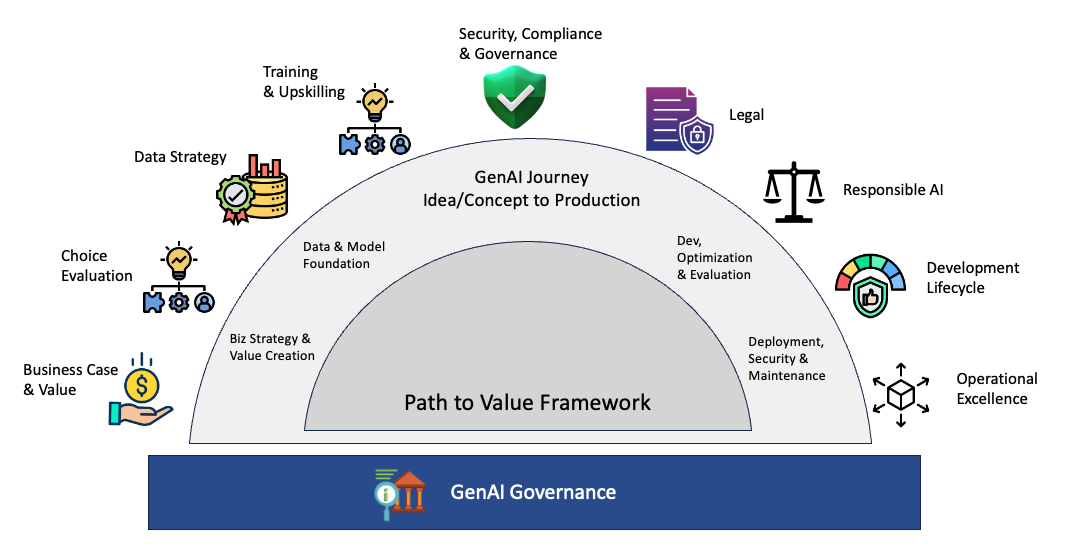

生成AIパス・トゥ・バリュー(P2V)フレームワーク

生成AIパス・トゥ・バリュー(P2V)フレームワークは、技術系・非技術系の双方のステークホルダーに共通するメンタルモデルおよびロードマップとして機能します。これは、初期の発想から始まり、本番対応の実装を経て、持続的な価値の実現に至るまでの、生成AIワークロードのライフサイクルに関するガイダンスを提供します。フレームワークでは、本番を最終目標として扱うのではなく、ビジネス上のインパクトに至る道のりの途中におけるマイルストーンとして「本番対応の準備(production readiness)」を位置づけます。その目的は、生成AIの取り組みを大規模にスケールさせることを妨げる最も一般的な阻害要因(ブロッカー)を、組織が取り除けるようにすることです。

フレームワークの構造

このフレームワークは、3つの中核となる構成要素を通じて、実世界の実装経験を実践的なガイダンスへと翻訳します。

- 柱(Pillars): 対処すべき重要領域を表す

- チェックポイント(Checkpoints): 異なる段階での「準備完了」の状態を明確化する

- ガイダンスおよび成果物(Guidance and artifacts): 実行を支える具体的なツールを提供する

この構造は、組織が課題を理解するところから一歩進み、コンセプトから価値へと進む過程で、それらを一貫して解決し続けられるようにします。

直線的なプロセスではなく、相互に連結したシステム

P2Vフレームワークは、直線的に、ステップごとに適用することを想定していません。生成AIの導入は、まっすぐな経路で進むことはほとんどありません。その代わりに、組織はこのフレームワークを柔軟に、かつ非同期に適用し、複数の柱を並行して扱うべきです。たとえば、チームは同時に技術的な能力を構築しながら、ガバナンスのガードレールを整備し、さらに異なるユースケースに向けたビジネスケースを作り上げることができます。この並行アプローチは、全体としての本番化と価値創出への道のりを大幅に加速させる可能性があります。フレームワークの中心には、エンドツーエンドの生成AIの旅(journey)があり、初期のコンセプトから本番へのデプロイ、そして最終的には測定可能な価値の実現へと組織を導きます。P2Vの旅は、生成AIの導入のあらゆる段階で継続的な注意を必要とする、相互に連結した柱に依存しています。組織は、自らの成熟度や制約に応じて、複数の柱を並行して取り組むことがよくあります。この柔軟で包括的なアプローチは、生成AIの実装における重要な側面が確実に取り扱われるようにするのに役立ちます。組織は自分たちの状況に合わせてフレームワークを調整できます。ただし、PoC(概念実証)やMVP(最小実用製品)の段階に進む前に、基盤となる柱(ビジネスケース、データ戦略、セキュリティ、法務・法的コンプライアンス)を優先すべきです。

P2Vフレームワークの主要な柱

P2Vフレームワークは、旅(journey)を一連の基盤となる柱へと整理します。各柱は、生成AIの取り組みを、実験から本番へ、そして持続的なビジネス価値へと進めるために対処すべき重要な次元(dimension)を定義します。各柱は、その領域がなぜ重要なのかを説明し、チームが対処すべき主要な注力ポイント(focus areas)を示すことで、意図(intent)と実行(execution)を統合します。組織は、いくつかが簡単な評価で済む場合でも、各柱を体系的に進めるべきです。各柱をそれぞれ固有の視点で見直すことで、重要なギャップが見落とされないようにできます。今後の投稿では、各柱についてさらに深く掘り下げます。

ビジネスケースと価値創出

競争の激しい環境では、生成AIへの投資は明確なリターンを示す必要があります。この柱では、事業成果を定義し測定することに焦点を当て、取り組みが単なる概念実証(PoC)を超えて、定量化可能な価値を提供する本番のソリューションへと進むようにします。成功を測定可能にし、投資が意味のある成果につながるようにすることを重視します。

主要な注力領域:

- ビジネス価値テンプレート – 価値提案と期待される成果を記録するための、構造化されたテンプレートを作成する

- コスト意思決定マトリクス – 実装コストを潜在リターンと比較して評価するための枠組みを確立する。プロンプトキャッシュ、知識蒸留、コンテキスト管理、知的ルーティングによるモデル階層化、緊急性のないワークロード向けのバッチ推論(割安で利用可能)、本番トラフィック向けのプロビジョンドスループットなど、コスト最適化手法を適用する。

- ビジネスKPIとインパクトの定量化 – ビジネスへの影響とパフォーマンスを測定するための指標を定義する

- メリットと成功のROI指標 – 投資対効果を追跡し、実現されたベネフィットを検証する

- 測定可能なビジネス成果 – 時間の経過とともに、具体的なビジネス結果を定義しモニタリングする

リソース

- なぜモデル選択が重要なのか:柔軟なAIがイノベーションの自由を解き放つ

- 変革をもたらすAIは、明確なユースケースから始まる

- Generative AI ATLAS – ビジネス価値とユースケース

- 生成AIのユースケースと洞察によってビジネス価値を提供する:CxO向け

- コスト、レイテンシー、精度の最適化

- Amazon ElastiCache をセマンティックキャッシュとして Amazon Bedrock と組み合わせることで、AIのコストとレイテンシーを削減する

- Amazon OpenSearch Serverless と Amazon Bedrock を使って read-through(リードスルー)セマンティックキャッシュを構築する

- Amazon Bedrock のための効果的なコスト最適化戦略

- 効果的なキャッシュで LLM の応答コストとレイテンシーを最適化する

データ戦略

高品質なデータは、成功するAIの土台です。この柱では、ますます複雑になるモデルに頼るのではなく、エンタープライズのナレッジシステムから高品質なデータを統合することを重視します。データ品質、ガバナンス、統合に注力することで、技術的な複雑さを抑えつつ、多くの場合より良い成果を得られます。さらに、合成データは既存の情報資産を意味のある形で拡張する場合に限り、補強として活用できます。

主要な注力領域:

- データ収集と準備 – 関連データを収集し、前処理するためのガイドラインを確立する

- データ品質と完全性 – データの正確性と信頼性を支える基準を定義する

- データ基盤とガバナンス – データ資産を管理・統治するための枠組みを作成する

- ゴールデンデータセット – 学習と評価に使用するベンチマークデータセットの基準を定義する

- データパイプライン – 効率的なデータ処理のワークフローを構築する

- エンタープライズ・ナレッジ統合 – 生成AIシステムを組織のナレッジソースに接続する

- 合成データの生成 – 適切な場合に学習データを補強するための手法を適用する

- データ中心のパイプライン – AIライフサイクル全体を通じてデータ品質を維持する

リソース

セキュリティ、コンプライアンス、ガバナンス

生成AIが事業運営においてミッションクリティカルになっていくにつれ、責任ある実装が不可欠です。この柱では、生成AIを自信を持ってスケールするために必要なガードレールを定めます。これにより、組織はデプロイ後に追加するのではなく、最初からセキュリティ、コンプライアンス、ガバナンスを構築できます。焦点は、進展を可能にしつつ、変化し続ける規制やエンタープライズ要件を組織が切り抜けられるよう支援することにあります。

主要な注力領域:

- アクセス制御 – システムおよびデータへのアクセス許可を管理するためのプロトコルを定義する

- ガードレール – 悪用や意図しない結果を回避するのに役立つ安全性メカニズムを実装する

- 認可(オーソリゼーション)パターン – モデル、エンドポイント、データを保護するための一貫したパターンを適用する

- セキュリティのスケーリング – PoCレベルの制御を、本番レベルのセキュリティプロトコルへアップグレードする

- 業界別の考慮事項 – セクター固有の規制要因や標準への対応を支援する

- AI倫理評議会(カウンシル)フレームワーク – 構造化された監督・レビュー委員会を設置する

- 自己統治(セルフガバナンス)フレームワーク – 責任あるAI開発のための社内ポリシーを定義する

- 自動化されたAIリスク管理 – セキュリティおよびコンプライアンス上のリスクを継続的に監視し、軽減する

リソース

- AI のための AWS セキュリティリファレンスアーキテクチャ

- AWSにおけるエージェント型AIのセキュリティ

- Agentic AI Security Scoping Matrix:自律型AIシステムを保護するためのフレームワーク

選定の評価

適切な生成AIアプローチを選ぶには、技術仕様を比較するだけでは不十分です。この柱は、テクノロジーの意思決定をビジネス目標に結び付け、実装戦略とリソース最適化に関する明確な指針を提供します。これにより、企業規模でAI投資の最大のリターンを得ることができます。

主要な注目点:

- モデル概要と比較 – 一貫した基準を用いて異なるモデル・アーキテクチャを評価する

- 意思決定ツリー – 技術選定の意思決定に対して構造化されたアプローチを適用する

- 移行戦略 – 要件の変化に応じて、生成AIアプローチ間の移行を計画する

- マルチモーダル・アーキテクチャ – 複数のデータ型を扱うシステムに関する考慮事項を評価する

- ファインチューニング vs. RAGの意思決定マトリクス – ユースケースの必要性に基づいて、適切なカスタマイズ手法を選択する

リソース

AIへの信頼を築く:責任ある基盤と実装

責任あるAIは、企業の導入において今や中核要件となっています。この柱は、規制への適合に対応しつつ、利害関係者との信頼を構築するためのガードレールを定めます。責任あるAIを早期に運用化できる組織は、規律ある・透明性のある実践によって承認を加速し、競争力を強化できる可能性があります。

主要な注目点:

- モデルの考慮事項 – モデルの調達元や所有に関する影響を評価する

- プライバシーパターン – データおよび推論ワークフロー全体でプライバシー保護の技術を実装する

- 責任ある利用に関する考慮事項 – 生成AIのユースケースに伴う責任あるAIの影響を特定し、対応する

- バイアスの軽減– データおよびモデルにおけるアルゴリズム上のバイアスを検出し、低減する

- 透明性と解釈可能性– AIが導く判断を理解し説明できることを支援する

- ガイドラインとポリシー– trách任あるAIの利用に関する基準を定義する

- AIガバナンス評議会とフレームワーク – ガバナンスと監督の仕組みを提供する

- 自動化されたAIリスク管理– 責任ある利用およびコンプライアンス上のリスクを継続的に監視する

リソース

開発ライフサイクル

本番環境で生成AIを成功させるには、複雑さに迷い込むことなく、適切な技術アプローチを選定する必要があります。この柱は、評価、アーキテクチャ、実装のための明確な指針を提供し、システムがスケールしても技術的な意思決定がビジネス成果とコスト効率に確実に整合するようにします。重点は、制御性、再現性、測定可能なインパクトを維持しながらチームが高度な機能を採用できるようにする、規律ある開発実践です。

主要な注目点:

- 評価指標とテスト – モデルの性能を測定し、ふるまいを検証するための基準を定義する

- 評価プロセス – 構造化されたテストと検証のアプローチを確立する

- オンラインおよびオフライン評価 – 本番前のテストと実運用での利用に応じて、異なる評価手法を適用する

- LLM支援による評価 – 評価者として機能するLLMのような手法を用いて、大規模に応答品質を評価する

- アプリケーション固有の指標 – タスク完了や回答の正確さなど、ユースケースに沿った指標を定義する

- Human-in-the-loop: 精度、安全性、整合性の向上に役立つよう、AIライフサイクル全体にわたって人間の判断を統合する。

- モデル・アーキテクチャ選定 – 技術的な実装選択を導く意思決定フレームワークを適用する

- タスクと出力モダリティ – テキストのみ、またはマルチモーダル応答など、対象となる出力に基づいてアーキテクチャを選択する

- タスク種別と事前学習データ – タスクの性質と利用可能なデータに基づいてアプローチを選ぶ

- ドメイン固有の考慮事項 – 業界特有の要件や制約を考慮する

- インフラとリソース – コストとレイテンシーのためにインフラを計画し、リソース利用を最適化する

- マルチモーダル・アーキテクチャ – テキストや画像など、複数の入力または出力タイプを含むシナリオをサポートする

- 実装ガイドライン – 生成AIシステムをデプロイするためのベストプラクティスを確立する

- 統合アプローチ – 生成AIコンポーネントを既存の企業システムおよびワークフローと接続する

- モデル開発 – モデル構築と改善のための一貫した基準を適用する

- 最適化の考慮事項 – 運用コストを増やさずに、性能と効率を向上させる

リソース

運用上の卓越性

生成AIの導入が成功するか、停滞した実験で終わるかの違いは、運用の実行にあります。この柱は、継続的な最適化、KPIモニタリング、規律あるコスト管理を通じて、生成AIシステムを本番環境で確実に稼働させることに焦点を当てます。強力なフィードバックメカニズムにより、予測可能な性能を維持しながら、システムは時間とともに改善できます。重点は、生成AIを一度きりのデプロイではなく、長期間稼働する本番ワークロードとして扱うことです。

主要な注目点:

- 運用 – 日々の本番管理のためのガイドラインを確立する

- 負荷分散と弾力性 – 推論トラフィックの急増のような変動需要に対応する

- 監視とログ – システムの挙動と障害について可視性を維持する

- 自動デプロイ – モデル、プロンプト、設定の更新を合理化する

- インフラストラクチャ管理 – ランタイムリソースを管理し最適化する

- パフォーマンスとスケーラビリティ – 大規模環境でも一貫したレイテンシとスループットを維持する

- 幻覚(ハルシネーション)の検出と軽減 – 数学的に妥当な検証とライフサイクル管理を用いて、単純なガードレールを超え、事実の正確性の向上と、モデルの長期的な信頼性の向上に役立てる。

- モデルの保守と改善 – 本番環境のシグナルに基づいて継続的にモデルを改良する

- レジリエンスと復旧 – 障害やサービス中断を扱うためのプロトコルを定義する

- 継続的な最適化 – パフォーマンス、品質、効率を反復的に改善する

- 可観測性 – データ、モデル、アプリケーションにわたるエンドツーエンドの可視性を維持する

- 本番KPIのモニタリング – システムの健全性と利用状況を反映する運用指標を追跡する

- フィードバックループの実装 – ユーザーとシステムのフィードバックを継続的な改善に取り込む

- FinOpsとコスト管理 – 運用コストを監視・最適化して稼働コストを抑える

リソース

- AWS における生成AIライフサイクル運用エクセレンスのフレームワーク

- Amazon Bedrock AgentCore で AI エージェントを PoC から本番へ移行する

- AWS Well-Architected 生成AIレンズの発表

- Amazon Bedrock Knowledge Bases と検証済みセマンティックキャッシュで、LLM エージェントの幻覚を減らす

- 自動推論チェックで AI の幻覚を最小化し、最大 99% の検証精度を実現する

- きめ細かなクロスモデル整合性による、ゼロ知識の LLM 幻覚検出と軽減

スキルアップとトレーニング

生成AIの成功を継続させるには、技術と同じくらい人が重要です。この柱では、生成AIを効果的に採用し、運用し、拡張していくために必要なスキルと組織としての準備態勢を構築することに焦点を当てます。目的は、技術的な能力がビジネス価値に直接つながるようにすることです。実際のユースケースに合わせてトレーニングを行い、インパクトを測定することで、組織は導入を進めつつ、エンブレーメン(能力開発)への取り組みと成果の間に明確なつながりを維持できます。

主要な注力領域:

- スキル構築のための自習コース – 生成AIのコンピテンシーを育成するための体系的なカリキュラムを開発する

- 業界・ユースケース固有のガイダンス – 関連するビジネスおよび技術の状況に合わせてトレーニングを調整する

- ビジネス価値の実現手法 – 新しく獲得したスキルを測定可能な成果に結び付ける

- ROI測定のフレームワーク – トレーニング投資の効果を定量化する

- チェンジマネジメント戦略 – 採用を推進し、生成AIを日々の業務フローに組み込む

リソース

- Generative AI ATLAS – ATLAS は、生成AIの実装に向けた検証済みの技術コンテンツとガイダンスを提供する、包括的なナレッジハブです。基礎から高度なデプロイ戦略までをカバーします。

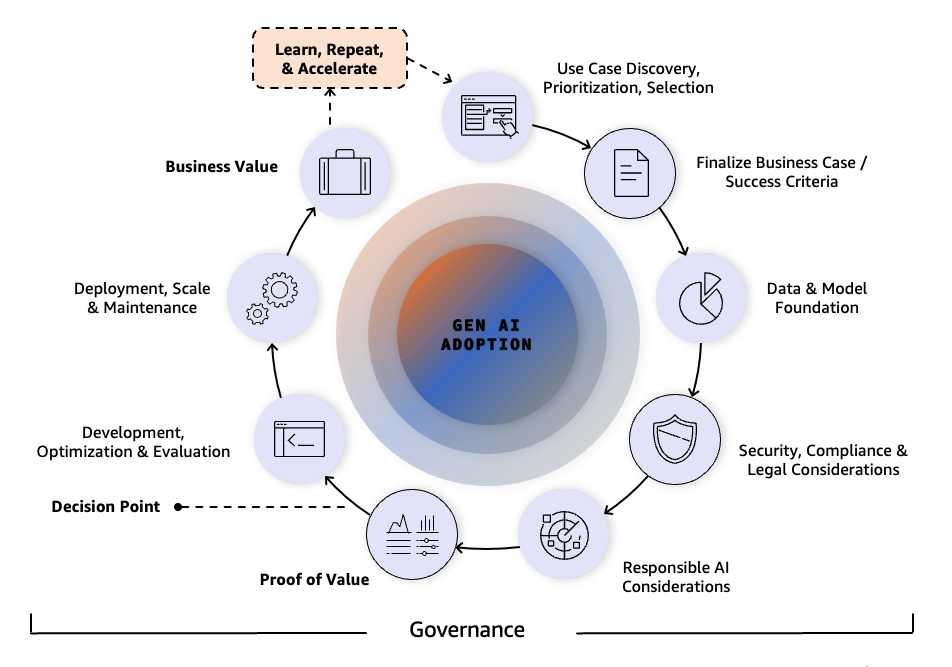

生成AI導入の旅

生成AIパス・トゥ・バリュー(P2V)フレームワークは、メンタルモデルとして、生成AI導入の道のりを単純化します。これは、初期のコンセプト開発から、本番環境での実装に向けた段階、そして持続可能な価値創出までを導く、柔軟で相互に連結されたシステムを提供します。業界非依存、ユースケース非依存、技術非依存のフレームワークであるため、多様な組織の状況やシナリオに適用できます。

単一の段階に最適化するのではなく、同フレームワークは長期的な成功を左右する次元を体系的に扱います。つまり、価値創出、リスク管理、技術的な厳密さ、そして人の変革です。組織は、自らが選ぶタイミングで、自分たちのペースに合わせてこの旅を進められます。その際、ビジネス目標との整合と、責任あるAIの実践を維持します。

P2Vフレームワークは、意図的に硬直したウォーターフォール型のアプローチではありません。これは、事前に備えるためのガイドであると同時に、製品化(本番環境へのデプロイ)や価値実現に苦戦している組織が、ギャップを素早く特定し、前に進むためのカスタマイズした道筋を作るのを助ける診断ツールとしても機能します。その柱を通じて、同フレームワークは処方的な(指針となる)ガイダンスを提供し、チームが現在の状態に最も関連する領域に集中できるようにします。新しいユースケースを見つけているのか、優先順位を見直しているのか、本番デプロイを強化しているのか、採用を拡張しているのかにかかわらず、このフレームワークは成果に重点を置き、各段階で明確な方向性を示します。

導入の旅の可視化は、このアプローチを、フレームワークの相互に連結された要素と、あらゆるフェーズでの成果の重要性を強調することで補強します。これらの依存関係を明示することで、モデルはチームが、最終的に重要なこと——持続的なビジネス価値を提供すること——を見失うことなく複雑さを乗りこなせるように支援します。

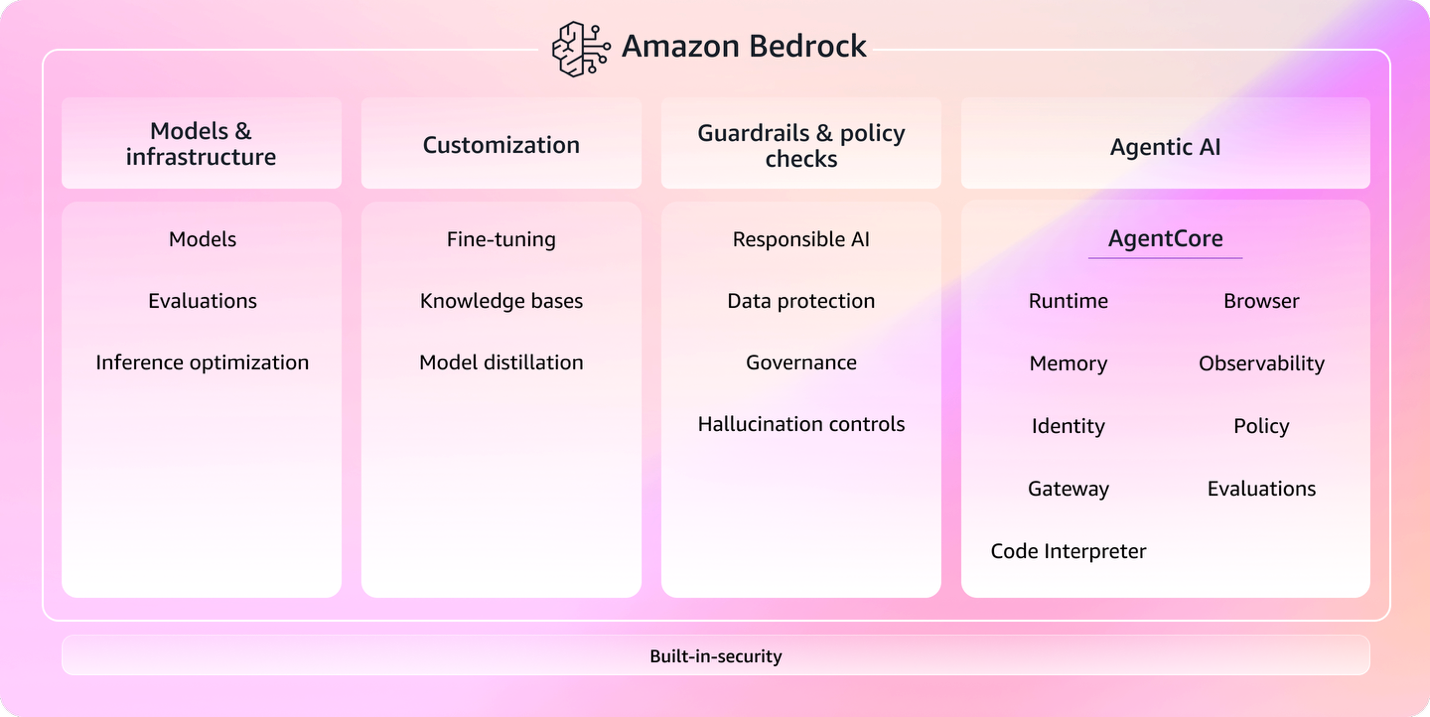

Amazon Bedrock を紹介します

Amazon Bedrock(本番規模で生成AIアプリケーションとエージェントを構築するためのサービス)は、コンセプトから本番への移行を効率化することで、組織が Path-to-Value の旅を実行するのを支援します。モデルアクセス、セキュリティ、スケーラビリティといった主要な P2V の要素に対応する、生成AI実装のための統一された環境を提供します。

マネージドインフラストラクチャ、組み込みのガバナンス制御、エンタープライズ統合機能を提供することで、Amazon Bedrock は運用上の摩擦を減らし、本番環境の準備を加速できます。これにより、チームは差別化されないインフラ上の懸念に費やす時間を減らし、P2Vフレームワークを適用して測定可能なビジネス成果を提供することにより集中できます。

生成AIアプリケーションの構築方法を再考する

P2Vフレームワークは、生成AIの旅の中で組織が押さえるべきことを扱いますが、そのスピードはチームの作り方に大きく左右されます。人が主導する順次プロセスを前提に設計された従来のソフトウェア開発の実践は、実証(POC)から本番(production)への取り組みを停滞させる、見えにくいボトルネックになりがちです。AI-Driven Development Lifecycle(AI-DLC)は、単なるコーディング支援ではなくAIを中核的な協力者として位置付けることで、強力なパターンを軸にライフサイクル全体を作り直します。つまり、AIは計画の作成を助け、明確化を求め、実装を支援し、人間は重要な判断を行います。AI-DLCの3つのフェーズ(Inception、Construction、Operations)は、概念から本番まで、そして継続的な価値へと至るP2Vの旅と対応しており、技術的な作業をビジネスの成果やガバナンス要件に確実に整合させたまま、開発サイクルを数週間から数時間へ圧縮できる可能性があります。各フェーズは持続的なコンテキストを構築し、そのまま引き継がれるため、段階間で取り組みを滞らせがちな情報の損失や手戻りの削減につながります。P2Vフレームワークを適用する組織は、開発ライフサイクルの実行エンジンとしてAI-DLCを採用でき、フレームワークのガイダンスを、生成AIを本番規模で運用する際に必要となる人間による監督を損なわずに、より速く・より高品質な提供へと変換するのに役立ちます。さらに詳しくは、AWS re:Inventの完全なセッションをご覧ください。AI-Driven Development Lifecycle(AI-DLC)を紹介

結論

Generative AI Path-to-Valueフレームワークは、生成AIの導入に伴う複雑さを乗り越えるための包括的なメンタルモデルを提供します。コンセプトから本番で利用可能な状態、そして価値の創出に至るまでの完結した道のりにわたってガイダンスを提示することで、このフレームワークは各段階でよくある課題に組織が対処できるよう支援します。生成AIの取り組みが停滞している組織に対しては、障害の原因を診断し、前進するための道筋を調整するための的を絞ったガイダンスを提供します。成功する実装には多くの側面があることを確実に考慮できるようにします。生成AIが進化し続ける中で、このメンタルモデルは、規模を問わずこの技術を活用しようとする組織にとってのリソースとして機能します。

Path-to-Valueフレームワークを使って生成AIを実装する方法について詳しくは、AWSのアカウントチームにお問い合わせいただくか、以下のリソースをご覧ください。