中国企業による米国ビッグテックの生成AI(人工知能)サービスへの「ただ乗り蒸留」疑惑が、相次いで明るみになっている。蒸留とは、既存のモデルの学習結果を用いて新しいモデルをつくり出す技術のことだ。米Anthropic(アンソロピック)や米OpenAI(オープンAI)は2026年2月、自社の生成AIサービスを中国企業が不正に利用し、蒸留により新しいモデルを開発したと主張した。

2社はこうした蒸留について、膨大な投資により開発したモデルへただ乗りする行為だとして非難する。さらに、蒸留により開発されたモデルは悪用リスクが高く、安全保障上の脅威となる恐れがあると指摘している。日本企業にとっても、ただ乗り蒸留へ知らない間に加担するリスクがあり得る。

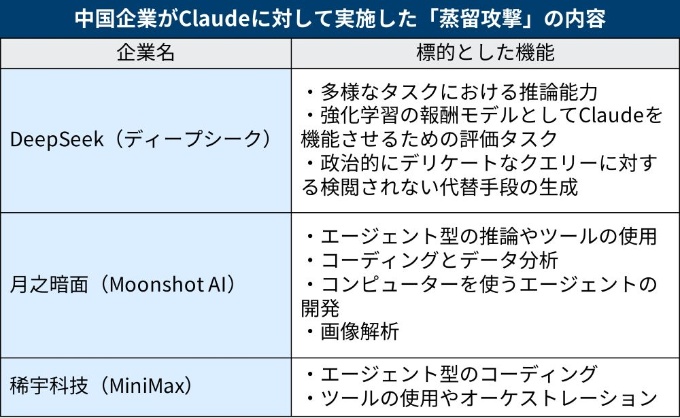

アンソロピックは、中国のDeepSeek(ディープシーク)、月之暗面(Moonshot AI)、稀宇科技(MiniMax)の3社がアンソロピックのモデル「Claude」の能力を不正に抽出し、自社のモデルを改良しようとする大規模な動きを特定したと発表した。アンソロピックは3社の動きを「蒸留攻撃(distillation attacks)」と呼んでいる。

2万4000アカウント駆使、不正蒸留のネットワーク構築

アンソロピックの2026年2月23日付の報道発表によると、3社は約2万4000のアカウントを通じてClaudeと1600万回以上のやり取りを生成しており、アンソロピックの利用規約や地域アクセス制限に違反したという。

アンソロピックは現在、安全保障上の理由から中国企業にClaudeへの商用アクセスを許可していない。中国企業はこの規制を回避してClaudeにアクセスするため、不正アカウントの広大なネットワークを構築した。このネットワークにより、ある1つのアカウントが凍結されても即座に別の新しいアカウントが代替できるようにしていたという。

例えばある企業は、単一のネットワークで2万件以上の不正アカウントを同時に管理しており、蒸留と無関係なリクエストを混在させることで、アンソロピックによる蒸留の検出を困難にしていた。

中国企業は取得した不正アカウントから、アンソロピックのモデルに大量のプロンプトを送信していたという。例えばディープシークの用いたプロンプトは、生成した回答の背景にある内的推論を想像し、明確に表現し、段階的に書き出すよう指示するような内容だった。

このプロンプトは、AIへ段階的に深く思考させて高精度な回答を生成する「思考の連鎖(Chain-of-Thought)」を自社のモデルに学習させるためのものであったとアンソロピックは見ている。

中国企業による蒸留に言及したのはアンソロピックだけではない。米ブルームバーグ通信によると、オープンAIは2026年2月12日、米連邦議会下院の特別委員会に宛てた書簡で、ディープシークなどによるモデルの蒸留について言及した。アンソロピックの主張と同様、中国企業が複数アカウントを使ってオープンAIの生成AIに大規模で組織的な不正アクセスを実施し、その結果を使ってモデルを開発したとしている。

米Google(グーグル)の脅威インテリジェンス分析組織Google Threat Intelligence Group(GTIG)も2026年2月13日、Geminiへの蒸留攻撃の増加に関する報告書を発表している。具体的な企業名は挙げていないが、「世界中の研究者や民間企業によるモデルの盗難や機能抽出の試みを特定し阻止した」としている。

次のページ

日本企業、「踏み台」で加担させられる恐れこの記事は有料会員限定です