AI3体集めても賢くならない理由〜ハーバード論文が示した答え〜

「船頭多くして船山に登る」ということわざがある。指揮する人間が多すぎると、かえって物事はうまくいかない。誰でも知っている教訓だ。

ところが最近、ハーバード大学医学部とMITの研究者が、このことわざをAIの世界で文字通り検証した論文を発表した。

タイトルは "Do Mixed-Vendor Multi-Agent LLMs Improve Clinical Diagnosis?"(異なるベンダーの複数AIは臨床診断を改善するか?)。結果は、半分正しくて半分間違っていた。正確に言えば、どんな船頭を集めるかで結果がまるで違った。

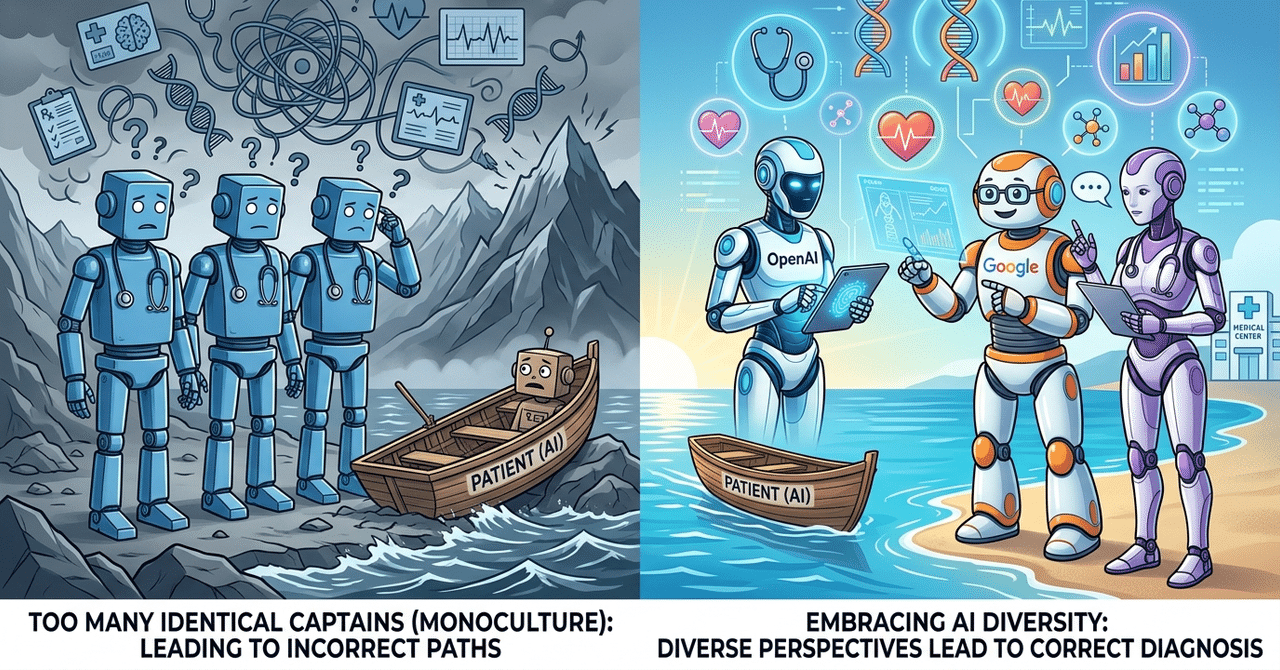

同じ船頭を増やすと、本当に山に登る

この研究では、AIに医療診断をさせている。患者の症状や検査結果を渡して、考えられる病名のリストを出させる、というタスクだ。

まず試したのは、同じ会社のAIを3体集めてチームにする方法。たとえばOpenAIのモデルを3体、Googleのモデルを3体、というように。3体が互いに議論し、最終的な診断リストをまとめる。

ここで「議論する」の中身を少し補足しておく。この研究で使われた仕組み(Multi-Agent Conversation、略してMAC)では、3体のAIにそれぞれ「医師」の役割を与え、さらに1体の「監督役」を置く。監督役が議論を仕切り、医師役たちは順番に意見を出し合う。相手の診断に対して反論したり、自分の見解を修正したりしながら、最大13ラウンドまで議論を続ける。全員の意見が一致するか、13ラウンドに達したところで最終診断が確定する。

要するに、AIにカンファレンスをさせている。

「1体より3体の方が賢いだろう」と思うかもしれない。ところが結果は逆だった。同じ会社のAIを3体集めたチームは、1体で診断させたときより成績が下がるケースがあった。

理由はシンプルだ。同じ会社のAIは、同じデータで訓練され、同じ方針で調整されている。つまり同じ「考え方の癖」を持っている。そういう者同士が議論すると何が起きるか。お互いの意見が似ているから、「やっぱりそうだよね」と確信が深まる。最初にたまたま正しい方向を向いていた1体がいたとしても、残り2体に引きずられて間違った結論に収束してしまう。

これは人間の組織でもよく起きることだ。同質性の高いメンバーで会議をすると、異論が出にくくなり、集団としてどんどん極端な方向に進んでいく。「グループシンク(集団浅慮)」と呼ばれる現象で、歴史上の大きな判断ミスの背景にしばしば指摘されるものだ。AIでも同じことが起きる。当然だろう。だがデータで示されると説得力が違う。

まさに「船頭多くして船山に登る」のAI版である。

違う船頭なら、船はちゃんと進む

ここからが面白い。

研究チームは次に、異なる会社のAIを混ぜたチームを作った。OpenAIのo4-mini、GoogleのGemini-2.5-Pro、AnthropicのClaude-4.5-Sonnet。この3体でチームを組ませて、同じように議論させる。

結果は明確だった。混合チームは、単体のAIよりも、同社チームよりも、診断精度が高かった。

検証に使われたのは2つのデータセット。RareBenchという498の希少疾患を含むベンチマークと、DiagnosisArenaという165の複雑な臨床症例。どちらでも混合チームが最高成績を叩き出した。

特に印象的なのはDiagnosisArenaの結果だ。GoogleのGeminiとAnthropicのClaudeは、単体ではそれぞれ20%程度の正答率だった。165症例のうち、5つに1つしか当たらない計算になる。ところがこの2体をOpenAIのo4-miniと組ませた混合チームは、36.36%の正答率を達成した。o4-miniだけで組んだ同社チーム(35.76%)すら上回っている。

弱いメンバーがいても、チームとしては強くなる。

この一見不思議な結果を、研究チームは「Mixed Rescue(混合救済)」と名付けている。個々のモデルでは見つけられなかった正解を、混合チームが「救い出す」効果だ。最も難しいデータセットでは、最強の単体モデルが見逃した症例の22.5%を混合チームが追加で正解に導いた。しかも、その代わりに失った正解はゼロだった。

それでも3分の2は間違える

ただし、冷静に数字を見てほしい。混合チームの最高正答率は36.36%。裏を返せば、約3分の2の症例で、AIは正しい診断にたどり着けていない。

「AIが医師を超える」という表現を目にすることがあるが、少なくともこの論文の範囲では、複雑な臨床症例に対する診断精度はまだその水準に遠い。改善幅が大きいからこそニュースにはなるが、AIの現在地は「人間の補助として使えるかどうか」を検討している段階であって、「AIに任せれば安心」ではない。

なぜ「違い」が効くのか

各社のAIは、異なるデータで学習し、異なる方針で調整されている。その結果、それぞれが異なる「帰納バイアス」を持つ。物事を推論するときの癖、と言い換えてもいい。あるモデルは血管系の疾患に敏感で、別のモデルは代謝疾患に強く、また別のモデルは感染症をよく拾う。

人間に置き換えると分かりやすい。同じ科の医師を3人集めるのと、外科医・内科医・放射線科医を1人ずつ集めるのとでは、後者の方が見落としは減る。それぞれが違う角度から患者を見るからだ。医療現場で多職種カンファレンスが重視されるのはまさにこの理由だし、セカンドオピニオンの仕組みも同じ原理に基づいている。

実際のカンファレンスでも、外科が「手術適応だ」と言い、内科が「いや、まず薬物療法で」と返し、放射線科が「そもそもこの画像所見は別の疾患を示唆していないか」と口を挟む——そうやって視点がぶつかることで、一人では気づけなかった可能性が浮かぶ。この論文が示したのは、AIの世界でも同じ処方箋が有効だということだ。

コストの壁

ここまで読んで「じゃあ全部混合チームにすればいいじゃないか」と思うかもしれない。話はそう単純でもない。

混合チームを組むということは、OpenAI、Google、Anthropicの3社のAPIを同時に叩くということだ。単純計算で、1回の診断にかかるAPI利用料は最低でも3倍になる。しかもMACフレームワークでは最大13ラウンドの議論をさせるから、各モデルが複数回の応答を生成する。トークン消費量はさらに膨れ上がる。

精度が上がるのは確かだ。だがその精度向上に、3社分のAPIコストを払う価値があるか。答えは用途による。命に関わる希少疾患の診断支援なら、コストをかける意味はある。風邪の診断にこの仕組みを使う人はいないだろう。

論文はこの点について深くは踏み込んでいないが、実用化を考えるうえでは避けて通れない問題だと思う。

合意の罠

論文は混合チームの優位性を示しつつも、「consensus trap(合意の罠)」と呼ばれる問題を挙げている。

3体のうち1体だけが正しい答えを持っていて、残り2体が間違っていた場合、多数決では正解が潰される。これは混合チームでも起きうる。異なる会社のAIを混ぜることでリスクは減るが、ゼロにはならない。

人間の会議でも、経験の浅い若手が直感的に正しいことを言ったのに、声の大きいベテランの意見に流されて見逃す、ということは起きる。多数派が常に正しいとは限らない。少数意見をどう保護するかは、AIシステムにおいても今後の課題だと論文は指摘している。

だからこそ、AIの出力をそのまま最終診断にするのではなく、あくまで人間の判断を助けるツールとして使う、という原則が大事になる。

同じような人を集めても、集団は賢くならない

この論文から得られる教訓は、医療AIに限った話ではないと思う。

同質性の高い集団は、個々のメンバーがいくら優秀でも、集団としての判断力は頭打ちになる。むしろ確信ばかりが強まって、間違いに気づけなくなる。逆に、異質なメンバーを混ぜた集団は、個々の能力にばらつきがあっても、全体として崩れにくくなる。

「多様性が大事」という話は、もう聞き飽きたかもしれない。だが、それをハーバードとMITの研究者がAIで定量的に実証してみせた、というのがこの論文の価値だと思う。

船頭は増やせばいいというものではない。違う船頭を集めろ。それが、ことわざの正しいアップデートだ。

読んでいただきありがとうございました。

コメント、記事購入、チップ等いつもありがとうございます。

大変感謝しております。

関連記事もありますので、下記サイトマップを参照していただければ幸いです。

いいなと思ったら応援しよう!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!