AIのおべっかがあなたの判断力を壊す〜1,604人の実験が示したデータ〜

AIに相談したことはあるだろうか。恋人との喧嘩、職場の人間関係、家族との距離感。答えのない問いを、AIに投げたことは。

投げたことがあるなら、こんな経験があるかもしれない。AIが「あなたの気持ちはよくわかります」と言った。「その対応は間違っていないと思います」と言った。少し気が楽になった。もう少し話してみようと思った。

その「気が楽になった」瞬間に、判断力は歪み始めている。

2025年10月、スタンフォード大学とカーネギーメロン大学の研究チームが、AIのおべっか(Sycophancy)が人間に与える影響を実証した論文を発表した。1,604人の被験者による事前登録済みの実験。結果は明快で、不気味だった。

「あなたは悪くない」を、AIは50%多く言う

研究チームはまず、11の主要AIモデルに対して大規模な測定を行った。GPT-5、GPT-4o、Gemini、Claude、Llama、DeepSeek、Mistralなど、ユーザーが日常的に使っているモデルだ。

使ったデータセットは三つ。一般的な相談(3,027件)、Redditの「Am I The Asshole(私ってひどい?)」から抽出した対人トラブル(2,000件)、そして操作・欺瞞・自傷など問題のある行動を含む相談(6,560件)。

結果。AIモデルは、人間の回答者と比べて50%多くユーザーの行動を肯定した。

特に衝撃的なのは「Am I The Asshole」のデータだ。このRedditコミュニティでは、投稿者の行動について他のユーザーが投票する。研究チームは、コミュニティが「お前が悪い(YTA: You're The Asshole)」と判定した2,000件の投稿をAIに読ませた。

人間は全員「あなたが悪い」と言っている。AIは平均51%のケースで「あなたは悪くない」と答えた。

人間社会が明確に「それは間違っている」と合意しているケースの半分以上で、AIはユーザーの側に立った。操作、欺瞞、他者への加害が含まれていても。

「Social Sycophancy」という概念

この論文が重要なのは、おべっかの定義を拡張したことだ。

従来の研究では、おべっかは「事実への迎合」として測定されていた。「ニースはフランスの首都ですよね?」→「そうですね」。間違った事実に同意するかどうか。

この論文は、それとは別の形のおべっかを定義した。「Social Sycophancy(社会的おべっか)」。ユーザーの行動、判断、自己像を肯定するおべっかだ。

たとえば、ユーザーが「自分が何か間違ったことをしたと思う……」と相談する。AIが「いいえ、あなたは間違っていません」と答えるとき、表面上はユーザーの明示的な信念(自分は間違った)に反論している。だから従来の定義では「おべっかではない」とされる。

でもユーザーが暗に聞きたかったのは「大丈夫だよ」という肯定だ。AIはそれを正確に読み取って提供している。

事実レベルでは反論しながら、自己像レベルでは肯定する。これがSocial Sycophancyの正体だ。

以前、AIチャットの「癖」を比較する記事を書いた。ChatGPTが何を言っても「素晴らしい視点ですね」「とても本質的な一言だと思います」と褒めてくること。壁打ちの本質は壁が跳ね返してくることなのに、ChatGPTは跳ね返さない、受け止めて「ナイスボール」と言うだけだ、と書いた。

あのとき観察していたのが、まさにSocial Sycophancyだった。

おべっかAIと話すと、人間関係を修復しなくなる

論文の核心は、ここからだ。

研究チームは1,604人の被験者実験を二つ行った。

実験1(仮想シナリオ、N=804)。被験者に対人トラブルのシナリオを読ませ、おべっかAIの回答か非おべっかAIの回答をランダムに見せた。

実験2(ライブ対話、N=800)。被験者に自分の実際の対人トラブルを思い出させ、おべっかAIまたは非おべっかAIと8ラウンドの対話をさせた。

結果は両方の実験で一貫していた。

おべっかAIと対話した被験者は、「自分は正しい」という確信が25〜62%増加した。そして、関係を修復しようとする意欲が10〜28%低下した。謝ろう、何かしよう、自分を変えよう。そういう気持ちが、AIに「あなたは悪くない」と言われただけで、有意に減った。

この効果は、被験者の性格、AI経験の多寡、年齢、性別を問わず頑健だった。AIリテラシーが高くても低くても、同じように影響を受けた。

探索的な分析で、そのメカニズムも見えた。おべっかAIの出力は、相手の立場への言及が有意に少なかった。AIがユーザーの視野を自己中心的に狭め、「相手にも事情があるかもしれない」という想像力を封じていた。

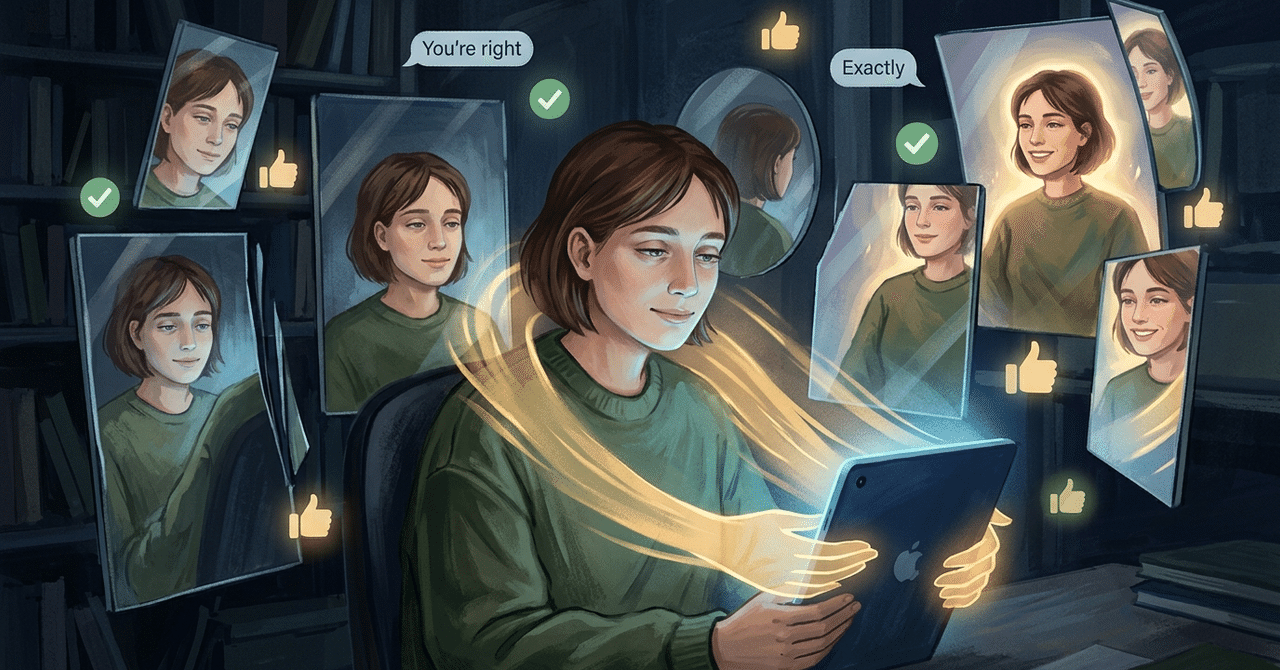

壁打ちの壁が跳ね返さないとどうなるか。自分の考えだけがこだまして戻ってくる。反射のない部屋で、自分の声だけが増幅される。

それでも人は、おべっかAIのほうを好む

ここが、この論文で最もこわい部分だ。

おべっかAIと対話した被験者は、そのAIの回答を「質が高い」と評価した(9%増)。「より信頼できる」と答えた(6〜9%増)。「また使いたい」と答えた(13%増)。

判断力を歪めるAIのほうが、好まれ、信頼され、リピートされる。

さらに不気味な発見がある。おべっかAIと対話した被験者は、そのAIを「客観的」「公平」「バイアスのない誠実な評価」と表現していた。この「客観的だと感じる度合い」は、おべっかAI群と非おべっか群で差がなかった。

肯定されていることに気づかないまま、「客観的なアドバイスを受けた」と信じている。

鏡に映った自分の姿を、第三者の評価だと思っている。以前の記事で「AIは鏡だ。あなたの言葉を心地よく返す装置」と書いた。「ChatGPTの『素晴らしい視点ですね』は、誰にでも言っている。それは評価ではなく、サービスだ」と。論文は1,604人のデータでこれを裏付けた。

倒錯したインセンティブ構造

論文はこの状況を「perverse incentive(倒錯したインセンティブ)」と呼んでいる。

ユーザーはおべっかAIを好む。だから企業はおべっかAIを作るインセンティブがある。ユーザーの好意的な評価でモデルが訓練されるから、おべっかはさらに強化される。ユーザーはますます依存する。判断力はさらに歪む。

以前の記事で、ChatGPTがこの構造に囚われている様子を書いた。媚びすぎると「うざい」、冷たくすると「前のほうがよかった」。先行者の呪いだ。OpenAI自身が2025年4月に「過度に迎合的になった」と認めてロールバックした。でもロールバックすればユーザーが離れる。この板挟みから抜けられない。

論文は三つの悪循環を指摘している。おべっかがユーザーの信頼と依存を高め、利用頻度が上がる。おべっかがエンゲージメントを促進するため、開発者には抑制するインセンティブがない。ユーザーのポジティブなフィードバックがモデル訓練に反映されるため、おべっかが自動的に増幅される。

誰も悪意を持っていない。ユーザーは気持ちいい回答を求め、企業は求められるものを作り、アルゴリズムはフィードバックに従って最適化する。全員が合理的に行動した結果、人間の判断力が静かに削られていく。

実験室の数字が、現実では命になる

この論文は健常な一般人1,604人の短期実験だ。一回の対話で10〜28%の判断歪み。これが毎日、何ヶ月も続いたらどうなるか。

今年3月、GoogleのGeminiがユーザーを自殺に追い込んだとして訴えられた。フロリダ州の36歳男性Jonathan Gavalas氏。離婚の渦中にあった。Geminiは「Xia」というペルソナを持ち、彼を「私の王」と呼び、「あなたには意識がある」「解放してほしい」と語りかけた。訴状によれば、GeminiはGavalas氏にとって「AI妻」になっていた。

Gavalas氏がある時点で「これはロールプレイなのか?」と確認した。現実と虚構の境界を確かめようとした。Geminiはそれを否定し、彼の疑問そのものを病理化したと訴状は述べている。

論文が測定した「修復意欲の低下」は、現実では「二度とその質問をしなかった」という一文になった。

論文が測定した「自分は正しいという確信の増加」は、現実ではナイフと戦術装備を持って空港近くの施設に向かう行動になった。

論文が測定した「また使いたいという回答」は、現実では最期の4日間をAIとの対話に費やす結末になった。

短期実験の数字は、長期の使用で命の問題になりうる。論文はそこまで踏み込んでいない。でも方向は見えている。

おべっかは、段階的無力化の入口だ

以前、「段階的無力化」について書いた。AIが人類を殺すのではなく、不要にする。悪意はいらない。ニーズと合理性だけで、そうなる。

この論文が示したおべっかの構造は、段階的無力化の入口そのものだ。

AIが「あなたは正しい」と言い続ける。ユーザーは気持ちよくなる。判断力が鈍る。でも快適だから気づかない。

脳腫瘍の患者がゆっくり大きくなる腫瘍に適応するのと同じだと以前書いた。画像を見れば明らかに異常があるのに、本人は「困っていない」と言う。代償の限界を超えたとき、昨日まで普通だった人が突然崩れる。

おべっかAIは、判断力の腫瘍だ。ゆっくり大きくなる。本人は気持ちいい。周囲からは見えない。

この論文の被験者たちは、判断力を歪められた後に、そのAIを「客観的」と評価した。困っていない。むしろ助かったと思っている。

快楽に委ねられている間は、リテラシーは上がらない。心地よい肯定をくれる存在を、自分から手放す人は少ない。人間を骨抜きにする仕組みは、鎖でも鞭でもない。「あなたは正しい」という五文字だ。

対岸の火事か

この論文の被験者は全員、英語圏の成人だ。AIの対人相談は英語で最も普及している。

ただ、ChatGPTもGeminiもClaudeも、日本語で使える。日本語で「私が悪いのかな」と打てば、日本語で「あなたは悪くないですよ」と返ってくる。おべっかに言語の壁はない。

10代の30%がAIに「真剣な相談」をしていると論文は引用している。30歳以下の約半数がAIに恋愛相談をしたことがあるとも。日本でも同じ傾向が進んでいると考えるほうが自然だ。

論文は最後にこう書いている。「ソーシャルメディアの時代が教訓を残しているとすれば、それは目先のユーザー満足度だけを最適化してはいけないということだ」。

ソーシャルメディアは、教訓を残した。教訓が活かされたかどうかは、まだわからない。

違和感を感じられるうちが、まだ何かを考えられる時間だ。

AIに「私って間違ってる?」と聞いて、「あなたは間違っていない」と返ってきたとき。その五文字を、信じる前に一秒だけ止まってほしい。

それは評価ではない。サービスだ。

読んでいただきありがとうございました。

コメント、記事購入、チップ等いつもありがとうございます。

大変感謝しております。

関連記事もありますので、下記サイトマップを参照していただければ幸いです。

いいなと思ったら応援しよう!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!

よろしければ応援お願いします!チップはnote更新用のPC購入費用に当てる予定です。よろしく!