米Googleは4月22日(現地時間)、年次イベント「Google Cloud Next」で、独自開発のAIチップ「TPU」の第8世代を2モデル発表した。モデル学習向けの「TPU 8t」と推論向けの「TPU 8i」だ。いずれも今年後半に提供開始の予定だ。

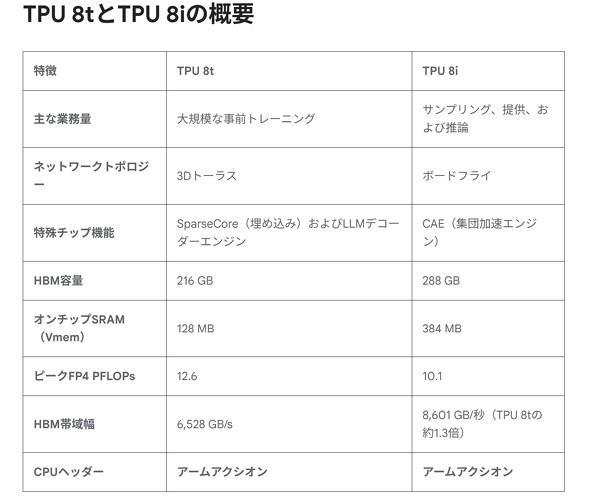

AIエージェントの普及に伴い、事前学習、事後学習、リアルタイムでの推論提供に対するインフラ要件が大きく分岐したことから、同社は学習と推論のニーズにそれぞれ特化させるデュアルチップアプローチを採用したとしている。

学習に特化したTPU 8tは、第7世代モデル「Ironwood」と比較し、単一のスーパーポッドで最大9600チップまで拡張可能であり、3倍の処理能力と最大2.7倍のコストパフォーマンス向上を実現している。

推論に特化したTPU 8iは、前世代の3倍のオンチップSRAMを搭載し、「Boardfly」と呼ばれる新ネットワークトポロジーによって遅延を大幅に削減することで、推論のコストパフォーマンスを80%向上させた。

また、両モデルともにワット当たりのパフォーマンス(電力効率)が最大2倍に改善された。

スンダー・ピチャイCEOは発表文で「AIエージェントの時代に、インフラは最も要求の厳しいAIワークロードを処理するために進化する必要がある」と語り、このアーキテクチャの重要性を強調した。

Google Cloudでは、これら第8世代TPUを、米NVIDIAのVera Rubin、Blackwell、HopperベースなどのGPUポートフォリオとともに主要なプロセッサの選択肢として顧客に提供していく。Google Cloudのプラットフォームでは米Anthropicの最新モデルをサポートしているほか、Safe SuperintelligenceやCitadel Securitiesなどの企業がTPUインフラを活用して最先端のAI研究やワークロードを推進している。

関連記事

IntelとGoogle、次世代AIインフラで提携強化

IntelとGoogle、次世代AIインフラで提携強化

IntelとGoogleは、次世代AIおよびクラウドインフラ推進に向けた戦略的提携の強化を発表した。Google Cloudへの「Xeon 6」プロセッサ導入に加え、インフラ処理を効率化する専用チップ「IPU」の共同開発を加速させる。CPUと専用インフラを統合し、AIワークロードの性能向上とコスト削減の両立を目指す。 Anthropic、GoogleとBroadcomとの提携拡大 次世代「TPU」で3.5GWのAIインフラ確保へ

Anthropic、GoogleとBroadcomとの提携拡大 次世代「TPU」で3.5GWのAIインフラ確保へ

Anthropicは、GoogleおよびBroadcomとの提携拡大を発表した。2027年稼働予定の次世代「TPU」を活用し、3.5GW規模のAIインフラを確保する。このリソースはClaudeの需要増に対応し、Google Cloudでも活用される。同社は、AWSやNVIDIAなどマルチベンダー戦略を継続し、システムの回復力向上を目指すとしている。 Google、第7世代TPU「Ironwood」一般提供開始 Anthropicもテスト中

Google、第7世代TPU「Ironwood」一般提供開始 Anthropicもテスト中

Googleは、第7世代TPU「Ironwood」の一般提供を発表した。「推論の時代」を支えるAIアクセラレータと位置づける。併せてARMベースの「Axion」VMの拡張も発表した。Ironwoodは専門タスク、Axionは汎用タスクを担い、両者の組み合わせでワークロードを最適化できるとした。 Google、TPU搭載の宇宙AIデータセンター構想「Project Suncatcher」発表

Google、TPU搭載の宇宙AIデータセンター構想「Project Suncatcher」発表

Googleは、衛星軌道上のAIデータセンター構想「Project Suncatcher」を発表した。TPU搭載の太陽光発電衛星群により宇宙でAI演算を行う計画で、地球資源への影響を抑える利点がある。2027年初頭にプロトタイプ衛星を打ち上げる学習ミッションを計画している。 Google CloudとAnthropicが提携拡大 AnthropicはTPUを最大100万個利用へ

Google CloudとAnthropicが提携拡大 AnthropicはTPUを最大100万個利用へ

Google CloudとAnthropicが提携拡大を発表した。AnthropicはClaudeの次世代モデルのトレーニングのため、GoogleのTPUチップ利用を大幅に増やし、最大100万個にアクセス可能になる。数十億ドル規模の取引で、2026年には1GW超の容量を利用する予定だ。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

続きを読むには、コメントの利用規約に同意し「アイティメディアID」および「ITmedia NEWS アンカーデスクマガジン」の登録が必要です